Após os recentes escândalos e mudanças no Facebook e Instagram, a rede social tem revelado algumas de suas políticas internas em relação ao conteúdo no Facebook. Em um post divulgado hoje no site oficial de notícias da plataforma, a vice-presidente da área de gerenciamento de produtos Monika Bickert revelou aos usuários como acontece o processo de avaliação das denúncias e novas medidas que ajudarão a garantir a liberdade de expressão dentro da mídia social.

Como é o processo de avaliação de denúncias no Facebook?

A primeira revelação interna feita sobre a equipe que avalia o conteúdo no Facebook é o número de escritórios ao redor do mundo. No total, 11 escritórios lidam com todos os posts marcados como inapropriados, com especialistas nas áreas do discurso de ódio, segurança infantil e terrorismo.

Esses especialistas – incluindo a própria executiva, que atuou como procuradora criminal – já possuem bastante experiência nesses assuntos antes de se juntarem ao Facebook, de acordo com a nota. Além disso, semanalmente a rede social conta com consultores externos para tratar desse assunto

Apesar das mudanças, o Facebook declarou três principais bases que regem as ações relacionadas à avaliação de conteúdo: segurança, voz e equidade, de maneira que todos possam se sentir livres para expressar sua opinião. Com base nisso, a executiva revelou que seu principal desafio na moderação do conteúdo no Facebook é identificar potenciais violações dos princípios descritos.

Para que essa moderação funcione, a plataforma mistura tecnologia e a ação humana, utilizando inteligência artificial e as denúncias enviadas por usuários para identificar potenciais ameaças. Relatórios são gerados a partir dessa combinação, que são revisados pela equipe operacional de comunidade do Facebook.

A equipe conta com cerca de 7.500 revisores de conteúdo que trabalham 24 horas por dia, analisando posts feitos em até 40 idiomas diferentes. A partir daí, o Facebook explica que, assim como todo trabalho humano, falhas podem acontecer e conteúdos que seguem as diretrizes de comunidade podem acabar sendo removidos por engano.

Novo recurso: apelações

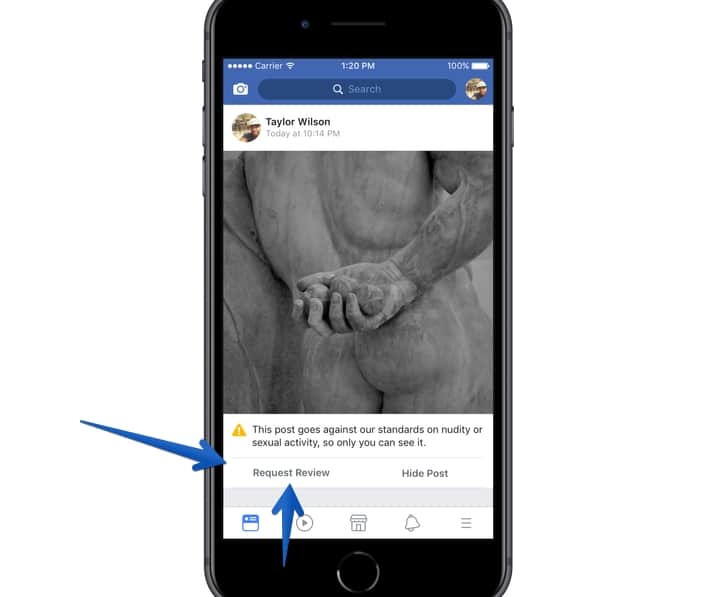

Por conta desses enganos, o Facebook irá liberar aos seus usuários a possibilidade de solicitar uma nova revisão do conteúdo, como se fosse uma apelação ou recurso em uma ação jurídica. Essa funcionalidade será liberada aos poucos durante esse ano e, atualmente, é possível pedir nova revisão para posts removidos por conter nudez ou atividade sexual, discurso de ódio ou violência gráfica.

Conteúdo no Facebook: o que acontece se a rede social tiver errado?

Quando um post seu for removido por algum desses motivos, você receberá uma notificação, permitindo que solicite uma nova revisão. Caso essa análise aponte que o engano foi do próprio Facebook, você receberá uma outra notificação, informando que seu post foi recuperado e pode ser visto novamente. No futuro, o Facebook planeja aumentar o número de violações que poderão ser enviadas para uma nova revisão.

Em uma iniciativa para aumentar a participação pública nas políticas do Facebook, a companhia irá, no próximo mês, sediar eventos públicos em países como EUA, Índia e França para discutir políticas da comunidade. Com toda a polêmica, a rede social está pretendendo abrir o jogo e suas respectivas regras para que os usuários saibam como funcionam seus processos internos para evitar a proliferação de boatos.

Leia também no blog: